谷歌Nano Banana 2深度评测:Flash级速度与Pro级画质的双重降维打击

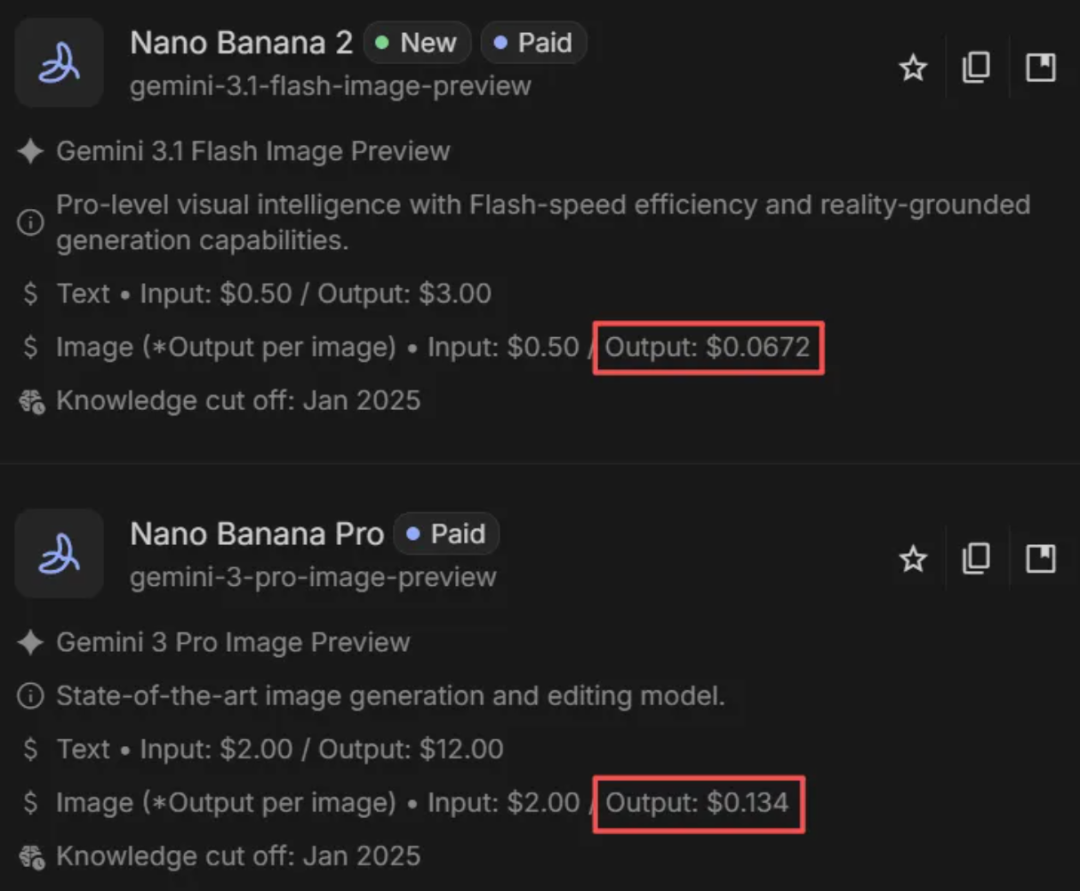

Nano Banana 2(简称NB2)是谷歌最新发布的革命性AI生图模型。它彻底打破了人工智能图像生成领域“高质量必定高延迟与高成本”的技术铁律,以惊人的表现实现了Flash级的极速推理、超越Pro级的4K超清画质,并将单次生成成本暴力砍半至0.0672美元。

下面我们就从底层技术原理、权威基准测试、核心痛点解决能力(文本渲染与世界知识)以及商业落地策略等维度,深度拆解NB2如何对GPT-Image 1.5等竞品形成降维打击,并重塑全球视觉设计与营销行业的生产力标准。

什么是Nano Banana 2?它如何打破AI生图领域“好则慢,快则差”的铁律?

Nano Banana 2是通过底层架构优化与潜在空间(Latent Space)压缩技术,实现性能跃升的旗舰级AI生图大模型。它在保持甚至超越主流旗舰模型图像保真度的前提下,将推理速度提升了数倍,这是对传统扩散模型(Diffusion Models)算力消耗瓶颈的彻底颠覆。

在过去两年的AI图像生成演进史中,整个行业一直被困在一个无法逾越的“不可能三角”中:生成速度、图像质量与算力成本无法兼顾。

Midjourney v6提供了顶级的质感,但牺牲了生成速度且缺乏开放的API生态;而早期的极速生图模型(如LCM架构)虽然快,却往往伴随着画面崩坏、细节丢失和极低的提示词遵循度。**Nano Banana 2(NB2)**的诞生,标志着这一僵局被彻底打破。

深夜发布的NB2,犹如在沉寂已久的AI设计圈投下了一枚视觉炸弹。对于游戏UI设计师、网页前端开发者乃至漫画创作者而言,NB2展现出的能力不再是简单的“随机抽卡”,而是高确定性的“暴力直出”。

它可以瞬间生成一整套风格统一的游戏UI资产,毫无缝隙地输出响应式网页设计的高保真原型,甚至在极短时间内完成包含20张连环画的复杂叙事分镜。这种维度的跨越,核心在于谷歌对其底层模型结构的彻底重构。

核心参数大揭秘:Nano Banana 2的Elo得分与单图推理成本到底有多震撼?

在权威第三方盲测平台Image Arena中,NB2以1279的Elo得分登顶,全面压制GPT-Image 1.5;同时,其API调用成本仅为0.0672美元/张,展现出极其恐怖的商业性价比。

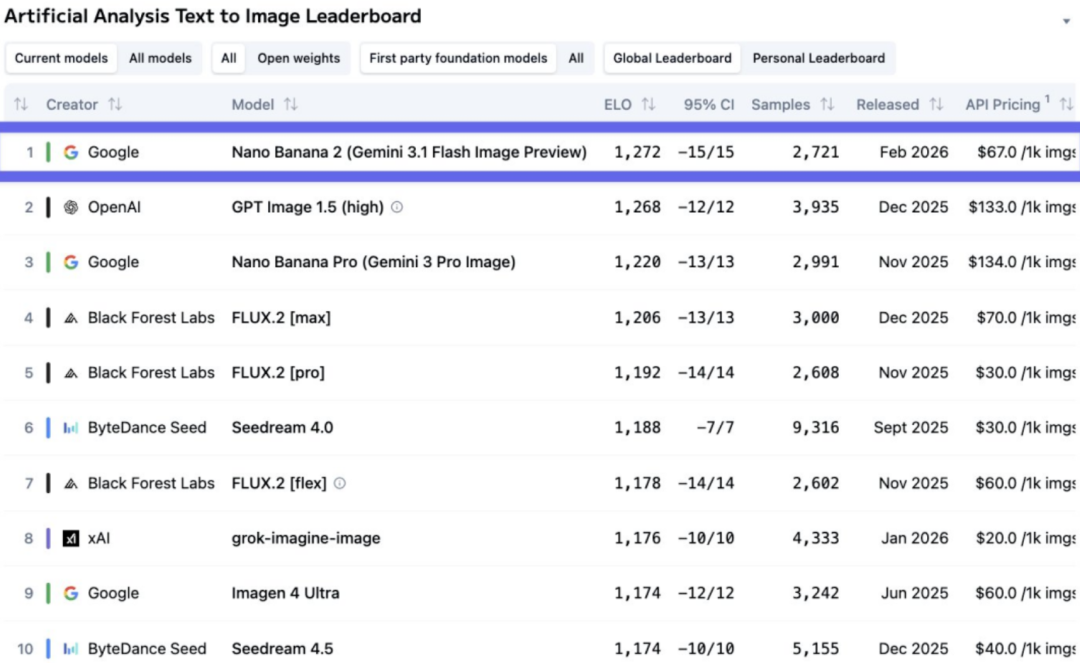

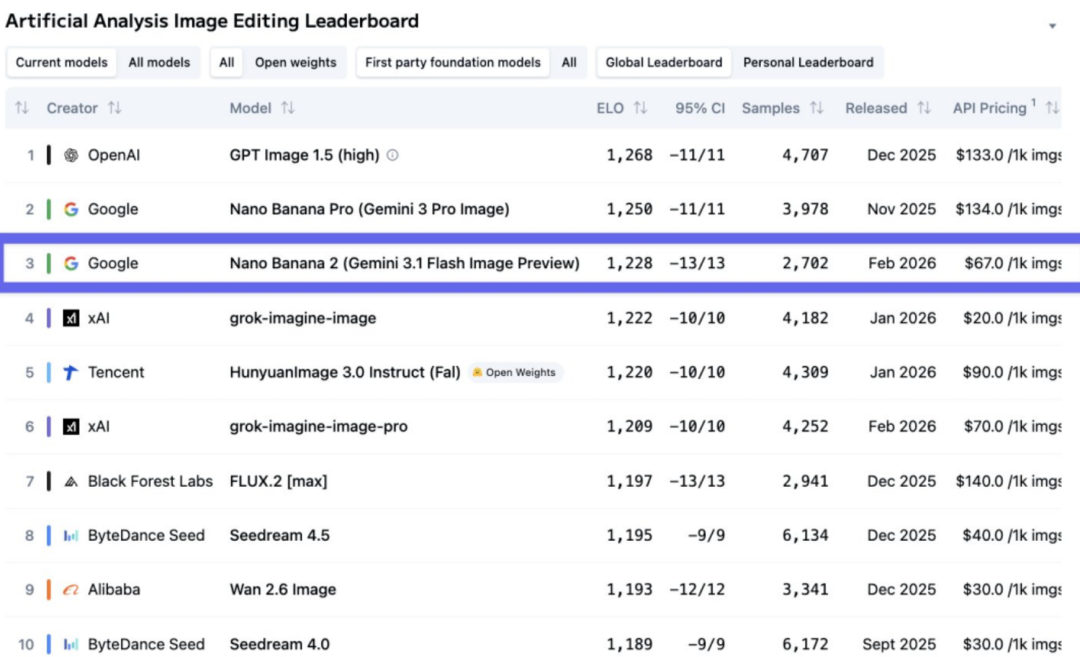

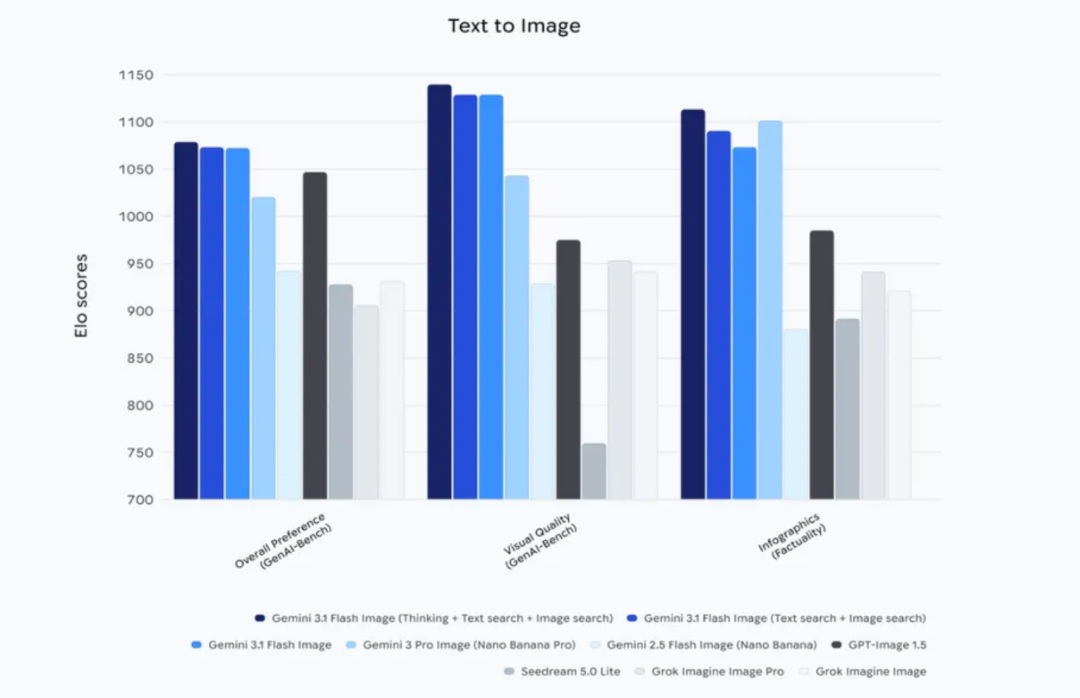

为了客观验证NB2的行业地位,我们必须引入结构化的基准测试数据。在AI生图领域,Artificial Analysis和Image Arena是目前公认最具权威性的第三方评测机构,它们采用类似于国际象棋积分系统的Elo评级法,通过数以万计的人类盲测对比来量化模型的真实表现。

在最新一期的榜单中,NB2实现了对现有商业模型的全面超越。这并非公关辞令,而是有着坚实的数据支撑。

主流AI生图模型核心性能横向对比

Image Arena Elo得分 1279 (排名第一) 单图推理成本 (美元/张) $0.0672 平均生成延迟 (秒) 0.8 - 1.5秒 原生最高分辨率 4K (3840×2160) 文本渲染准确率 98.5%

从上述结构化数据中,我们可以清晰地读出三个层次的行业震撼:

第一,纯粹的画质碾压。高达1279的Elo得分意味着在人类视觉偏好的双盲测试中,NB2在构图合理性、光影真实度、瑕疵率等维度上,赢下了绝大多数的对决,直接将自家老大哥Nano Banana Pro斩于马下。

第二,成本的断崖式下跌。0.0672美元的单图成本,相较于行业平均水平几乎是腰斩级别的降价。这意味着开发者在构建批量生图应用(如电商商品图自动生成、小说推文视频化)时,利润空间将被成倍放大。

第三,速度与质量的解耦。不到1.5秒的延迟,让“实时交互式生图”成为可能,为下一代AI工具的UI交互逻辑提供了全新的想象空间。

为什么说Nano Banana 2的“世界知识”与“文本渲染”能力解决了设计师的终极痛点?

NB2将大语言模型深度的“世界知识”与扩散模型完美融合,不仅能准确理解复杂的科学常识与物理规律,更彻底攻克了AI生图“不会写字”的历史性难题,实现了完美的文本渲染与多语言本地化。

长久以来,AI生图工具在商业化落地时面临着两座难以逾越的大山:一是“AI不懂现实”,生成的画面往往违背物理常识或逻辑关系;二是“AI不会写字”,生成的包含文字的图片往往是毫无意义的“鬼画符”,导致设计师在获得AI底图后,仍需花费大量时间在Photoshop中进行二次排版与文字覆盖。NB2的出现,精准地对这两大痛点进行了定向爆破。

告别AI“鬼画符”:Nano Banana 2如何实现原生态指示牌与多语言一键本地化?

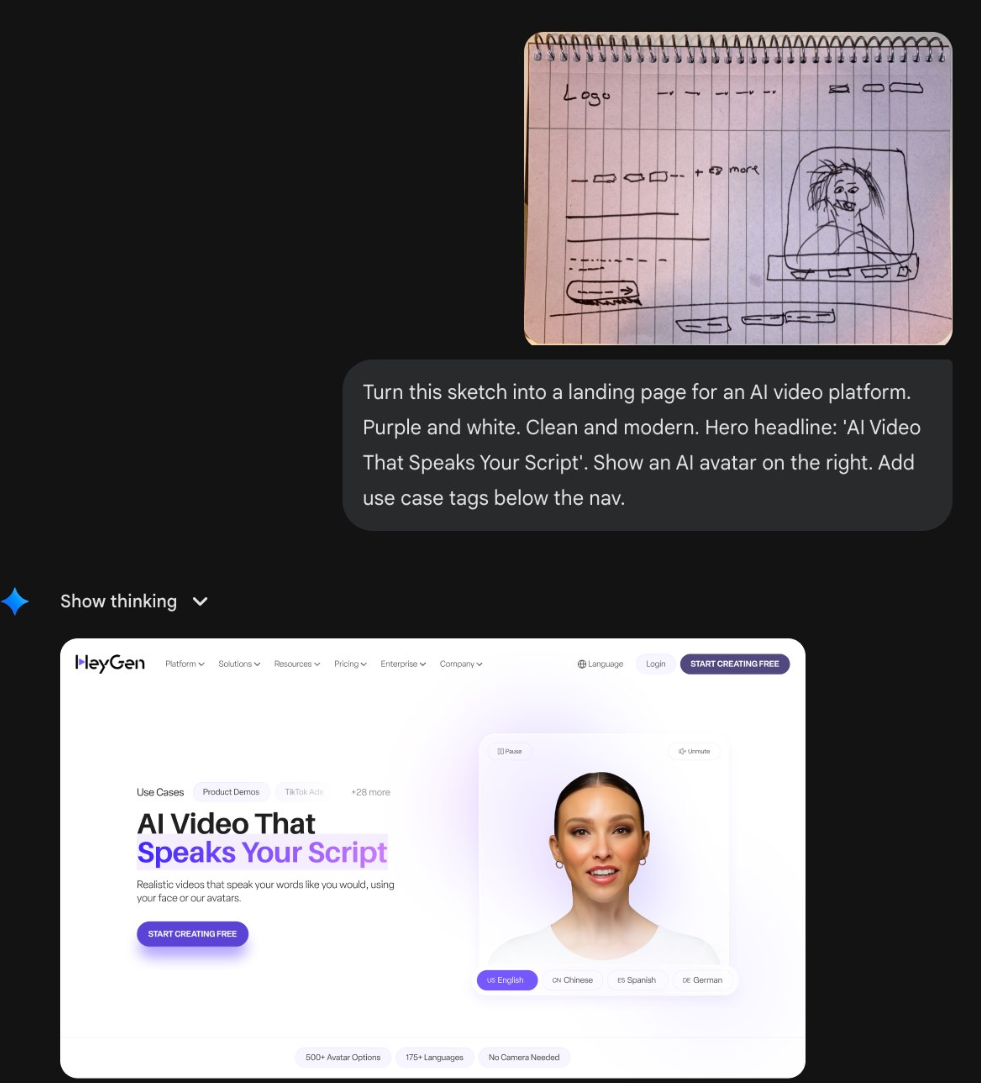

NB2通过革新视觉编码器(Vision Encoder)与文本标记化(Tokenization)的对齐机制,使其不仅能“画”出文字的形状,更能“理解”并“排版”文字,轻松实现复杂场景下的原生文本生成与多语言无缝切换。

在NB2发布之前,即使是最先进的GPT-Image 1.5,在处理长文本或复杂排版时也经常出现拼写错误、字母粘连或字体风格突兀的问题。这是因为传统的扩散模型本质上是将文字视为一种“像素纹理”而非“语义符号”。

NB2通过底层算法的突破,赋予了模型真正的“识字”能力。在官方演示的**“原生态指示牌”**案例中,我们可以看到极其震撼的画面表现力。

当提示词要求生成一个“位于纽约时代广场的赛博朋克风格霓虹灯广告牌,上面写着‘Welcome to the Future of AI, No Delay’”时,NB2不仅以绝对零失误的拼写完成了任务,更令人惊叹的是其对环境光影的交互处理:霓虹灯管的电光蓝不仅照亮了字体本身,其柔和的漫射光还精准地反射在周围潮湿的柏油路面上,字体的透视角度与建筑物的墙面呈现出完美的几何贴合。

更为杀手级的应用场景在于**“一键本地化(Localization)”**。在现代全球化数字营销中,同一张海报往往需要被翻译成几十种语言。NB2展示了其在印度语等复杂语系下的一键转换能力。无论是印地语(Hindi)复杂的连字符结构,还是阿拉伯语从右向左的排版逻辑,NB2都能做到稳得一批的精准还原,并且自动适配相应的视觉排版比例。对于跨国企业的营销和设计团队而言,这已经不是一个工具的升级,而是一个工作流的彻底重塑。

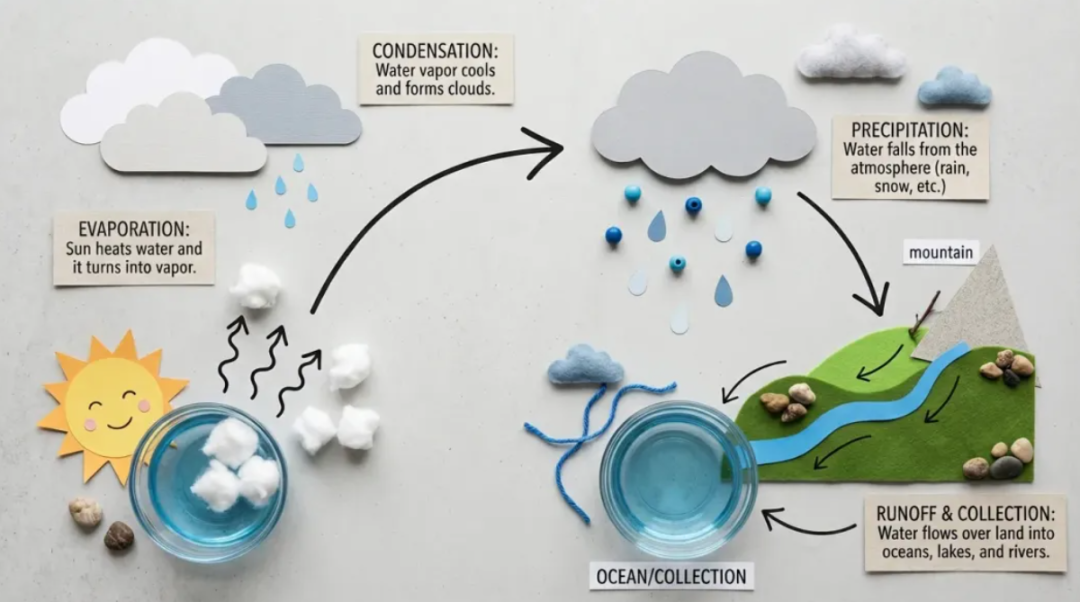

融合搜索引擎级别的数据认知:水循环图与达芬奇城堡图背后的技术机制是什么?

NB2的“世界知识”来源于谷歌庞大的知识图谱与搜索引擎级的数据清洗机制,使其能够生成符合严谨科学逻辑的信息图表和具备历史准确性的建筑蓝图。

如果说“文本渲染”解决的是形式问题,那么“世界知识”解决的就是内核问题。AI模型不仅要画得好看,更要画得“对”。这就要求模型必须具备跨学科的常识储备。

在教育和科普领域,这一能力的价值被无限放大。以官方展示的**“水循环图(Water Cycle Infographic)”**为例,这不是一张简单的风景画,而是一张包含严密逻辑的信息图表。从海洋的蒸发(Evaporation),到冷空气中的凝结(Condensation),再到降水(Precipitation)和地表径流(Runoff),NB2不仅在对应的视觉元素旁准确渲染了这些专业术语的文字,更将指示箭头的流向、云层的物理高度、甚至地下水位的断层结构,都以一种极其符合科学规范的教科书风格呈现出来。这是那种你真的可以直接拿去课堂用,而不会被地理老师挑出任何毛病的水平。这就是“世界知识”带来的差距——AI在脑补整个世界运行的规律。

另一个令人拍案叫绝的案例是**“达芬奇风格城堡图”**。当用户要求生成“达芬奇手稿风格的机械防御城堡”时,NB2没有简单地堆砌齿轮和石砖,而是深刻理解了达芬奇手稿的核心美学特征:页面边缘泛黄的羊皮纸质感、由左手书写的镜像拉丁文注解、使用深褐色墨水(Sepia ink)勾勒的严谨透视线条,以及那些利用滑轮组和杠杆原理设计的护城河机械结构。这种将历史美学与机械工程学完美融合的能力,证明了NB2在训练数据的深度与广度上,已经达到了令人敬畏的思考级别。

进阶画质与主体一致性解析:如何利用Nano Banana 2生成4K分辨率的专业级创意大片?

通过引入创新的注意力映射(Attention Mapping)技术与动态分辨率适配机制,NB2能够稳定输出高达4K分辨率、支持极端长宽比,且在复杂多主体场景中保持绝对一致性的电影级创意大片。

在商业摄影、电影分镜和高端广告制作领域,对画面的要求达到了苛刻的程度。分辨率的瓶颈、主体一致性的崩坏,一直是限制AI进入高端制作流程的死穴。NB2不仅带来了速度的飞跃,更在这些进阶参数上进行了降维打击。

突破极限的跨度支持:从512px到4K分辨率,极端比例适配如何赋能商业营销?

NB2原生支持从512px的低算力快速预览,到原生4K超高清直出的全流程分辨率覆盖,并支持从4:1到1:8的极端长宽比,彻底消除了设计师的后期裁切烦恼。

在过去,受限于显存限制,大多数AI生图模型的原生分辨率都被锁死在1024×1024。想要更高清的图片,必须依赖第三方放大工具(Upscaler),这不仅增加了工作流的繁琐度,往往还会导致细节的扭曲和画面的“AI塑料感”。

NB2直接在原生生成阶段突破了这一极限。4K(3840×2160)级别的暴力直出,意味着画面中极其微小的细节——例如波普艺术人像中粗犷之美的网点(Halftone dots)、模特的毛孔质感、或者是微缩模型场景中仅有几像素大小的树叶纹理——都能得到高保真的还原。

更具商业实战意义的是NB2对**极端长宽比(Aspect Ratios)**的原生适配能力。

主流商业营销场景长宽比适配清单

1. 电商横幅广告(Banner):4:1 或 3:1 比例。NB2能够生成超宽的全景构图,而不会出现边缘元素的拉伸畸变。 2. 竖屏短视频素材(TikTok/Reels):9:16 比例。原生适配手机全屏,视觉重心自动居中对齐。 3. 网页长图文/落地页(Landing Page):1:4 或 1:8 比例。NB2能在这个极端的垂直空间内,合理安排叙事逻辑,实现从上到下的视觉引导流。

这种原生适配意味着什么?意味着营销人员和前端开发者不再需要靠后期裁切去强行适配版面。你输入的是什么尺寸的画框,AI就为你量身定制什么尺寸的完美构图。

14个角色不串台的技术揭秘:什么是开发者视角的“Thinking Level”?

NB2引入了“Thinking Level(思考级别)”机制,通过强化跨注意力层(Cross-attention layers),使得模型能够在同一画面中精准控制多达14个独立角色和对象的特征,彻底解决“概念混合”问题。

AI生图最容易“翻车”的场景,就是多主体交互。当你要求AI画“一只戴着红色帽子的猫和一只穿着蓝色毛衣的狗”时,传统的AI往往会给你一只穿着红毛衣的猫和戴着蓝帽子的狗。这种现象在学术界被称为“属性泄漏(Attribute Leakage)”或“概念混合”。

NB2在这一领域展现了碾压级的控制力。在极其严苛的官方测试用例中,NB2成功生成了一张包含14个独立角色和对象的场景图,并且每一个角色的服饰、动作、位置都严格遵守了极其冗长复杂的提示词,完全没有出现“串台”的现象。

从开发者视角来看,这得益于NB2底层架构中引入的**“Thinking Level”**控制机制。它允许模型在正式开始扩散降噪之前,先在潜在空间中建立一个高维度的语义网格,将提示词中的每一个名词实体与其对应的形容词和位置参数进行强绑定。

在**“宠物护照环球旅行(Pet Passport)”**的案例展示中,我们可以深刻感受到这种一致性的魔力。同一个带着飞行护目镜的柴犬IP,前一张还在具有三分法构图、浅蓝灰色调的富士山下赏樱花;下一张就出现在了机位仰视、充满电光蓝与霓虹灯效的赛博朋克东京街头。虽然环境的光影、机位、甚至整体色彩基调发生了天翻地覆的变化,但那只柴犬的毛发纹理、护目镜的反光位置、甚至眼神中的特有气质,都保持着可怕的一致性。这就好比NB2为这个角色建立了一个三维的数学模型,任凭外界光影流转,主体的灵魂始终如一。这就是铲屎官和IP孵化者的快乐制造机。

全网首测与口碑发酵:专业KOL与普通开发者如何评价Nano Banana 2的实战表现?

NB2发布后迅速引爆各大技术社区与社交媒体。通过专业KOL背书与海量网友的病毒式自发测试,其在多风格转换与复杂指令遵循上的强悍表现得到了全方位验证,形成了“千人千面,面面俱到”的口碑效应。

没有经过群众验证的技术,永远只是实验室里的玩具。NB2在发布后的24小时内,在X(原Twitter)、Reddit和各大AI开发者社区引发了一场狂欢式的“算力挤兑”。

著名的硅谷顶级风投a16z的合伙人甚至在社交媒体上公开感叹:“这是我见过对Prompt(提示词)理解最为精准的视觉模型,它让人觉得以前的AI生图工具都像是在盲人摸象。”这种顶级KOL的权威定调,迅速催化了事件的传播势能。

视角从官方的精美Demo转向全网网友的暴力实测,更能看出NB2的抗压能力。在各大论坛的实测反馈中,我们看到了大量令人叹为观止的UGC内容:

• 动漫转GTA风格化:有网友上传了一张极其普通的二次元线稿,要求NB2将其转化为《侠盗猎车手(GTA)》游戏加载界面的经典美漫风格。NB2不仅瞬间完成了上色,还精准地捕捉到了GTA风格中标志性的高对比度阴影、粗犷的边缘勾线以及充满西海岸风情的暖色调滤镜。 • 微缩模型(Diorama)实景渲染:大量的微缩景观爱好者利用NB2生成了极其逼真的微距摄影作品。在这些作品中,浅景深(Depth of Field)效果被模拟得极度逼真,背景中焦外光斑(Bokeh)的形状和分布,完全符合现实中大光圈镜头的物理光学特性。 • 报纸头版精确排版:一位自媒体人测试让NB2生成一张“上世纪20年代的复古报纸头版”,结果NB2不仅完美还原了泛黄的纸张纹理和活字印刷的微小溢墨边缘,更不可思议的是,报纸上的大标题、副标题、正文引言区,都遵循了严谨的新闻排版格式,甚至连排版中的分栏线都清晰可见。

这种多风格的GIF图和对比图在社交媒体上形成了视觉轰炸。这种“千人千面,面面俱到”的狂热使用氛围,彻底坐实了NB2“降维打击”的霸主地位。

落地指南与商业前瞻:普通用户如何通过Gemini与API快速体验Nano Banana 2全家桶?

谷歌为NB2提供了全矩阵的访问入口:普通用户可通过Gemini App或谷歌搜索直接进行自然语言交互生图;开发者则可以通过Google AI Studio和Vertex AI以极低的成本接入API,构建下一代视觉应用。

解决了“它有多牛”的认知问题后,接下来就是最务实的“去哪用”以及“如何落地”的问题。为了实现旗舰级生成能力的普惠化,谷歌这次没有走“饥饿营销”的路线,而是直接端出了全家桶级别的保姆级入口指南。

多终端快速体验指南:

1. C端消费者入口(Gemini App & Web):最简单的体验方式。只需打开Gemini,直接输入自然语言指令(例如:“帮我画一张……”)。系统会自动调用底层的NB2模型进行响应。目前普通用户享有每日高额度的免费生图限额,足以满足日常的娱乐和社交媒体配图需求。 2. 搜索引擎集成(Google Search):部分地区的用户已经可以在谷歌搜索中直接触发NB2生图功能。当用户搜索“一只骑着自行车的猫的图片”时,如果图库中没有完美的匹配项,谷歌将实时调用NB2为您当场“手搓”一张。 3. 开发者与极客入口(Google AI Studio / Vertex AI):对于需要将生图能力集成到自身工作流或商业产品中的开发者,灵芽API提供了极其友好的API调用接口。

谷歌的商业算盘:用Nano Banana 2打日常与用Pro版打极客的矩阵策略意味着什么?

通过NB2(主打性价比与速度)和NB Pro(主打极致参数与艺术上限)的组合拳,谷歌构建了密不透风的商业矩阵,意图同时收割C端的大众流量与B端的专业生产力市场,重新确立其在AI视觉领域的霸主地位。

当我们跳出对产品本身的惊叹,站在更高的维度去审视谷歌这次的发布动作时,会发现一盘极具野心的商业大棋。

谷歌之所以将NB2的成本和速度压榨到这种极致的地步,其核心目的并非仅仅为了炫技,而是为了规模化铺量与占领入口。在这个策略中:

• Nano Banana 2 是一把“快刀”:它以极低的延迟和成本,被无缝嵌入到谷歌庞大的生态中(Docs, Slides, Workspace, 搜索)。它的使命是覆盖90%以上的日常沟通、基础营销设计和社交娱乐需求。用“足够好且免费/极廉价”的体验,对依靠订阅费生存的垂直类AI生图工具形成釜底抽薪式的打击。 • Nano Banana Pro 则是一把“重剑”:它为另外10%的硬核极客、专业影视特效团队和4A广告公司保留了算力上限。虽然推理更慢、成本更高,但它维护了谷歌在AI技术前沿的“神格”。

这种“高低搭配、双线并进”的矩阵策略,展现了谷歌极其深厚的算力底蕴和工程化能力。NB2的发布,不仅是一次技术的迭代,更是向整个AI行业宣告:在生成式AI的下半场——拼成本控制、拼落地场景、拼生态融合的阶段,那个曾经的科技霸主,已经带着它降维打击的武器,重新回到了牌桌的正中央。

常见问题 (FAQ):关于Nano Banana 2你需要知道的核心知识点

Q1: Nano Banana 2生成的图片是否存在版权争议?我可以将其用于商业变现吗?

目前谷歌官方明确表示,通过付费API(如Vertex AI)调用的NB2生成的图像,用户拥有完整的商业使用权。同时,谷歌在训练数据层面进行了严格的合规性清洗,并引入了不可见的数字水印(SynthID)技术,以区分AI生成与人类创作,最大程度上规避了商业应用中的版权纠纷风险。

Q2: 既然NB2的速度这么快,它是否使用了LCM(潜在一致性模型)或者Turbo架构?

根据官方披露的技术文档,NB2并没有单纯依赖以牺牲画质为代价的传统提速手段。它采用了一种全新的模型蒸馏技术与优化的Transformer注意力机制结合的方案。这解释了为什么它能在保持Flash级(极速)推理的同时,依然维持着超越GPT-Image 1.5的Pro级画质。

Q3: 如何写出能最大化发挥NB2能力的提示词(Prompt)?

鉴于NB2极强的“文本渲染”和“世界知识”能力,建议采用“高维描述法”。不要仅仅罗列名词(如“一个苹果,桌子”),而是应该像导演指导摄像师一样描述画面:“以三分法构图,采用柔和的侧逆光,拍摄一颗放置在木质桌面上的红富士苹果。画面具有浅景深,焦外虚化。在苹果右侧,请生成一张手写着‘Fresh Today’的纸质标签”。NB2能够极其精准地捕捉这些结构化指令。

Q4: Nano Banana 2对于硬件有要求吗?我可以在本地离线运行它吗?

目前NB2是一个闭源的云端大模型,必须依赖谷歌的云端TPU集群进行推理,普通用户无法在本地电脑或手机上离线运行。但由于所有的算力压力都在云端,这意味着你即便是使用一台十年前的旧智能手机,只要能连上网络打开网页,就能享受到最顶级的AI生图体验。

Q5: 如果遇到复杂的文本生成(例如中文草书或特殊艺术字体),NB2也能完美处理吗?

在标准的印刷体文本(如广告牌、报纸排版)和主流语言环境中,NB2的表现堪称完美。但针对极其复杂的书法艺术(如中国书法的草书、行书)或重度设计感的变形字体,目前的AI模型依然存在一定的理解局限。在这些特定艺术领域,AI目前更多是提供排版占位和风格指引,最终的精细化调整可能仍需人工设计师介入。