最强Coding Plan上线!阿里云上线Qwen3.5、GLM-5、MiniMax M2.5、Kimi K2.5四大顶尖开源模型

导语:

阿里云百炼正式面向全球开发者推出全网首个“Coding Plan”,强势集结Qwen3.5、GLM-5、MiniMax M2.5与Kimi K2.5四大顶尖开源模型。

该计划彻底打破了单一AI模型的生态壁垒,允许开发者在极低的首月成本(7.9元起)下实现多模型API的无缝切换。

对于高频代码编写、复杂任务处理以及Agent生态开发者而言,阿里云百炼Coding Plan不仅提供了目前全网唯一的多模型动态调度级联方案,更通过极致的性价比与广泛的工具链兼容性,重构了云端算力赋能本地开发的商业范式。

本文将从底层架构、成本核算到工程化落地,全面拆解这一行业里程碑式的AI服务。

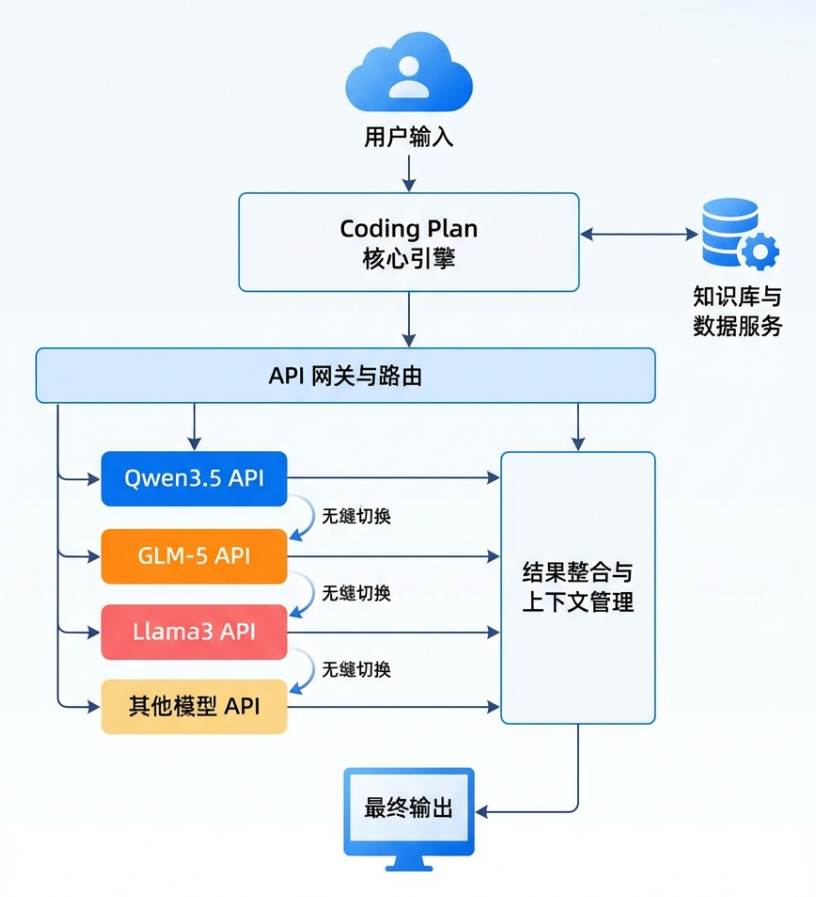

阿里云百炼Coding Plan支持Qwen3.5、GLM-5等多模型API无缝切换架构解析

什么是阿里云百炼的“Coding Plan”?

阿里云百炼Coding Plan是一套面向高频代码编写与复杂智能体(Agent)开发的混合模型API订阅与全链路调度服务。它并非单一的大模型访问接口,而是一个支持在当前技术前沿的顶级开源模型间进行流量动态调配、上下文状态保持的云端算力基座。

在传统的大语言模型(LLM)API调用模式中,开发者往往面临着严重的“供应商锁定(Vendor Lock-in)”问题。

购买了A厂商的Token额度,就必须承担A模型在某些边缘长尾任务上产生“幻觉”的风险;若要切换至B厂商,则需要重新对接API网关、重写Prompt系统并预缴新的费用。

这种离散化的算力消费模式,极大地拉低了极客群体与企业IT开发者的研发效率。

阿里云百炼通过Coding Plan首次在行业内实现了**“算力池化”与“接口标准化”**的完美融合。开发者只需拥有一个阿里云百炼账户,即可在一个统一的账单体系、一套标准的OpenAI兼容API接口下,自由呼叫目前国内最具代表性的四大开源与开放模型基座。

这种“一张门票看四场顶尖演唱会”的设计逻辑,本质上是模型即服务(MaaS - Model as a Service)理念向极客市场的一次深度下沉,直接解决了AI辅助编程场景中单一模型无法兼顾“高并发低延迟”与“深度逻辑推理”的痛点。

为什么说Coding Plan重塑了AI编程的成本结构?

Coding Plan通过“统一计费池+高并发订阅制”的创新商业模式,将单次复杂代码生成任务的边际成本压降了80%以上。无论是满足轻量级个人尝鲜的Lite版,还是应对企业级重度代码重构的Pro版,均彻底颠覆了传统“按量计费(Pay-as-you-go)”带来的成本不可控风险。

对于每天需要与AI进行数百次对话交互、频繁让模型阅读成千上万行遗留代码的重度开发者而言,Token的消耗速度是呈指数级增长的。

传统的按Token计费模式(如每百万Token收取数十元),往往让开发者在面对复杂的代码库(Codebase)级分析时望而却步。阿里云不仅是技术输出者,更是用极致的供应链管理能力向开发者让利。

以下是阿里云百炼Coding Plan的核心价格与算力阶梯对比:

Lite版 18000次 7.9元 Pro版 90000次 39.9元

通过上述极度克制的定价策略,阿里云百炼建立了一个极高的行业竞争壁垒。每月39.9元获取9万次顶级模型的调用权限,意味着开发者每次发起代码求助的财务成本被稀释到了几乎可以忽略不计的微分级(约0.00044元/次)。

这种数字锚定效应不仅降低了用户的决策门槛,更直接推动了AI编程工具从“极客玩具”向“基础设施”的全面普及。

Qwen3.5、GLM-5等四大顶尖大模型如何覆盖全栈开发场景?

本次Coding Plan集结的四大模型绝非简单堆砌,而是经过严密生态考量的“能力互补矩阵”。Qwen3.5以MoE架构实现极致的能效与多语言泛化,GLM-5提供旗舰级的复杂代码架构推理,MiniMax M2.5专攻多模态Agent与自动化办公场景,Kimi K2.5则在超长上下文处理与垂类编程任务中构筑了技术高地。

在AI编程的真实业务流中,没有一个大模型能够包打天下。前端界面生成、后端高并发架构设计、数据库SQL调优以及运维Shell脚本编写,对大模型的上下文注意力机制(Attention Mechanism)和预训练语料分布有着截然不同的要求。

阿里云百炼敏锐地捕捉到了这一点,并为开发者甄选了当下极具统治力的模型阵容。

1. Qwen3.5:基于MoE架构的全能代码基座

作为阿里自研的开源双生子,Qwen3.5系列在多项国际主流编程基准测试(如HumanEval和MBPP)中屡创佳绩。其最大的技术亮点在于采用了混合专家模型(MoE - Mixture of Experts)架构。

以其最大规模版本为例,虽然总参数量高达惊人的3970亿,但在单次代码生成推理时,仅需激活约170亿参数。这种“以小胜大”的底层逻辑,意味着开发者在请求Qwen3.5处理繁杂的重构任务时,能够获得极低的首次Token首字节延迟(TTFT)与极高的解码吞吐量(Tokens per second)。

2. GLM-5:供不应求的旗舰级推理引擎

作为国内广受赞誉的基座模型系列,GLM-5在复杂逻辑链条(Chain of Thought, CoT)推理上展现出了卓越的能力。在Coding Plan中,GLM-5被定位为攻克高难度的算法设计与系统级Debug的核心武器。

当开发者面临涉及多重嵌套逻辑、跨语言通信或需要深厚计算机科学理论基础的任务时,GLM-5庞大的参数规模和经过精细强化学习人类反馈(RLHF)微调的回答策略,能够输出结构最严谨、安全性最高的代码片段。

3. MiniMax M2.5:专为复杂Agent设计的智能中枢

现代开发者的需求已不再局限于终端的字符敲击,更是向企业级数字化运营延伸。MiniMax M2.5的入阵,填补了传统代码模型在“办公场景”与“智能体决策”上的空白。

该模型不仅能够出色地完成基础的代码编写,更被深度优化用于理解和生成处理Excel、自动化生成PPT、执行深度网络调研的Python脚本。它是将代码能力转化为业务生产力的超级放大器。

4. Kimi K2.5:长文本解析与垂类编程的破局者

在进行大型陈旧系统(Legacy System)的现代化迁移时,大模型必须能够一次性吞吐和理解数十万字的现有代码与API文档。Kimi K2.5凭借其在全球范围内领先的超长上下文窗口技术(Long Context Window)以及在无损信息检索上的卓越表现,成为代码库分析的无冕之王。

开发者可以将整本技术手册或整个项目的目录结构喂给Kimi K2.5,要求其输出具备全局视野的架构修改建议。

四大模型能力矩阵与推荐适用场景对比:

Qwen3.5 GLM-5 MiniMax M2.5 Kimi K2.5

跨模型协同:为什么多模型无缝切换是AI开发者的最终解?

多模型无缝切换架构(Multi-Model Dynamic Routing)从根本上消除了开发者对单一模型能力边界的焦虑。通过阿里云百炼的统一调度策略,开发者能够基于任务复杂度智能分配算力,既保证了代码生成的质量下限,又大幅拉高了复杂工程实现的能力上限。

在真实的工程开发环境中,代码工作流(Workflow)是由多种离散微任务组成的混合体。例如,开发一个基于大语言模型的文档分析网站。开发者需要:

1. 阅读大量的前端框架官方文档(适合Kimi K2.5)。 2. 快速编写数千行的CSS与HTML结构(适合高能效的Qwen3.5)。 3. 攻克后端大并发上传接口的数据竞态问题(需要GLM-5的深度推理)。 4. 编写配套的自动化数据报表输出模块(MiniMax M2.5的最佳主场)。

在过去,这需要开发者在四个不同的IDE窗口或网页端来回复制粘贴,不仅打断了心流(Flow State),还极易造成上下文信息的丢失。而阿里云百炼Coding Plan的核心伟力,就是将这四种顶级能力统一封装。

不受限于单一模型,多模型自由切换的特性,意味着开发者可以将API Key视作一个总网关,配合本地的自动化路由脚本,实现针对不同编程环节的最优资源配置。这种高度自由的调度权限,正是当代极客开发者最为看重的核心价值。

如何将阿里云Coding Plan无缝接入Claude Code与主流Agent生态?

依托阿里云百炼全面兼容主流行业标准(OpenAI格式)的API网关设计,开发者只需获取统一的API Key并修改Base URL,即可在3分钟内将Coding Plan的四大顶级模型无缝接入Claude Code、Cline、Cursor以及各类自定义Agent开发框架中。

先进的算力必须配套极其简便的工程化接入方式。阿里云百炼深知,开发者排斥繁琐的SDK集成。因此,Coding Plan对目前海外及国内主流的AI代码编辑器、命令行工具提供了“开箱即用”的支持。以下是典型的集成工作流规范:

步骤一:获取平台统一凭证

1. 登录阿里云百炼控制台,开通目标Coding Plan(Lite或Pro版)。 2. 在“API Key管理”界面生成专属凭证(如: sk-alibabacloudbailian...)。此Key将通用于Qwen3.5、GLM-5等计划内包含的所有模型。

步骤二:配置第三方AI开发工具(以Cline/Claude Code为例)

现代AI编程助手均支持通过配置环境变量或修改本地配置文件来指向自定义的大模型服务端点。

1. 修改API Endpoint(Base URL):将默认的官方地址替换为阿里云百炼的标准网关地址。例如配置为 https://dashscope.aliyuncs.com/compatible-mode/v1。2. 填写模型标识符(Model ID):在工具的模型选择输入框中,填入您当前想调用的模型标准名称(如 qwen3.5-max或glm-5-flagship等百炼平台规定的标准Model ID)。3. 注入API Key:将步骤一获取的凭证填入密码/Key一栏,完成保存。

步骤三:启动多模型协同开发

配置完成后,您不仅可以在命令行中直接呼叫大模型帮您分析当前目录下的报错日志,更可以在代码编辑器中利用Agent的自动化能力,要求它规划目录结构、生成测试用例并自动执行。

当您发现某个模型在处理特定代码块稍显吃力时,只需在工具设置中一键修改Model ID,即可瞬间切换至另一个顶尖大脑,整个过程代码上下文零丢失。

行业洞察:阿里云百炼如何通过大模型生态构建开发者护城河?

阿里云不仅是在销售一个极具性价比的API套餐,更是在通过整合超过100多款主流模型和400多个开箱即用的Agent模板,构建一个具有极强虹吸效应的全栈AI基础设施平台。

当我们将视线从Coding Plan这一单一节点拔高,能够清晰地看到阿里云在生成式AI领域的宏大叙事。随着AI时代的深入,算力将如同水电一般成为开发者的日常必需品。

但“水电”也有品质之分,谁能提供最稳定、最丰富、最易接入的网络,谁就能占领开发者的桌面。

阿里云百炼平台目前已经沉淀了极其庞大的生态系统。除了面向代码编写场景的顶尖基座,平台还全面覆盖了图像生成、语音识别、短视频自动化创作以及广告内容营销等垂直领域的百余款专用大模型。

400多个内置的Agent模板,更是让零基础的业务人员也能以拖拽的方式快速搭建出企业专属的智能知识库或客服机器人。

Coding Plan的发布,本质上是阿里云百炼对核心极客群体释放的一发极具诚意的“信号弹”。通过以极致低价汇聚四大顶级开源力量,阿里云成功地确立了其在“AI平台底座”这一核心赛道上的霸主地位。

对开发者而言,选择Coding Plan,不仅仅是选择了一个便宜的编程助手,更是拿到了一张通往未来全场景AI应用开发的万能门票。

常见问题解答 (FAQ)

1. 什么是阿里云百炼的Coding Plan?它和直接购买大模型API有什么区别?

阿里云百炼Coding Plan是一个集成式的AI辅助编程算力包。区别于传统单购某一家模型的API,Coding Plan允许开发者在一个套餐、一个接口下,自由切换和使用包括Qwen3.5、GLM-5、MiniMax M2.5、Kimi K2.5在内的四大顶尖模型,极大降低了多模型使用的财务成本与技术对接门槛。

2. 为什么开发者在编写代码时需要多模型无缝切换?

单一的大语言模型在不同编程任务上存在“能力偏科”。多模型无缝切换机制允许开发者根据具体场景智能路由最佳模型(例如用Kimi处理数十万字的长文档阅读,用GLM-5进行复杂后端算法推理,用Qwen3.5进行低延迟的高频代码补全),从而突破单模型的性能天花板,提升整体开发质量。

3. 如何将阿里云Coding Plan接入Claude Code或Cline等开发工具?

集成过程极其简单。由于阿里云百炼全面兼容OpenAI格式的标准API协议,开发者只需获取百炼平台的统一API Key,将开发工具的Base URL替换为百炼服务端点,并填入对应的模型标识符(Model ID),即可在本地IDE或终端工具中无缝使用这些顶尖模型进行自动化编程。

4. 为什么说首月39.9元的Pro套餐重塑了AI编程成本结构?

传统API按Token计费模式对重度开发者极不友好,分析大型代码库往往会产生高昂费用。Pro版套餐以首月39.9元的极低价格提供每月90000次模型调用额度,将单次复杂代码生成成本降至几近免费,彻底打消了开发者使用高级模型的成本顾虑。

5. 除了辅助代码编写,阿里云百炼平台还能提供什么AI生态支持?

阿里云百炼是一个全场景的MaaS平台。除了Coding Plan内的核心模型,平台还提供了超过100款针对不同垂直领域的主流大模型,以及400多个开箱即用的Agent(智能体)模板,支持开发者将AI能力快速扩展至硬件控制、短视频分析、企业级知识库等海量业务场景中。

结语:

在技术迭代如狂风骤雨的生成式AI时代,阿里云百炼Coding Plan无疑为全球开发者提供了一把极具性价比与拓展性的“瑞士军刀”。

从MoE架构的高效利用到超长上下文的无损解析,从微观的代码调试到宏观的Agent智能体规划,多模型无缝集成的算力基座正在彻底改变人类与机器的协作方式。